Wie fühlt es sich an, wenn die eigene Mannschaft schneller denkt als ihr Chef? Ein Essay über KI-gesteuerte Entscheidungsfindung, die Risiken des Kontrollverlusts durch KI – und die feinen Unterschiede zwischen menschlicher und maschineller Manipulation.

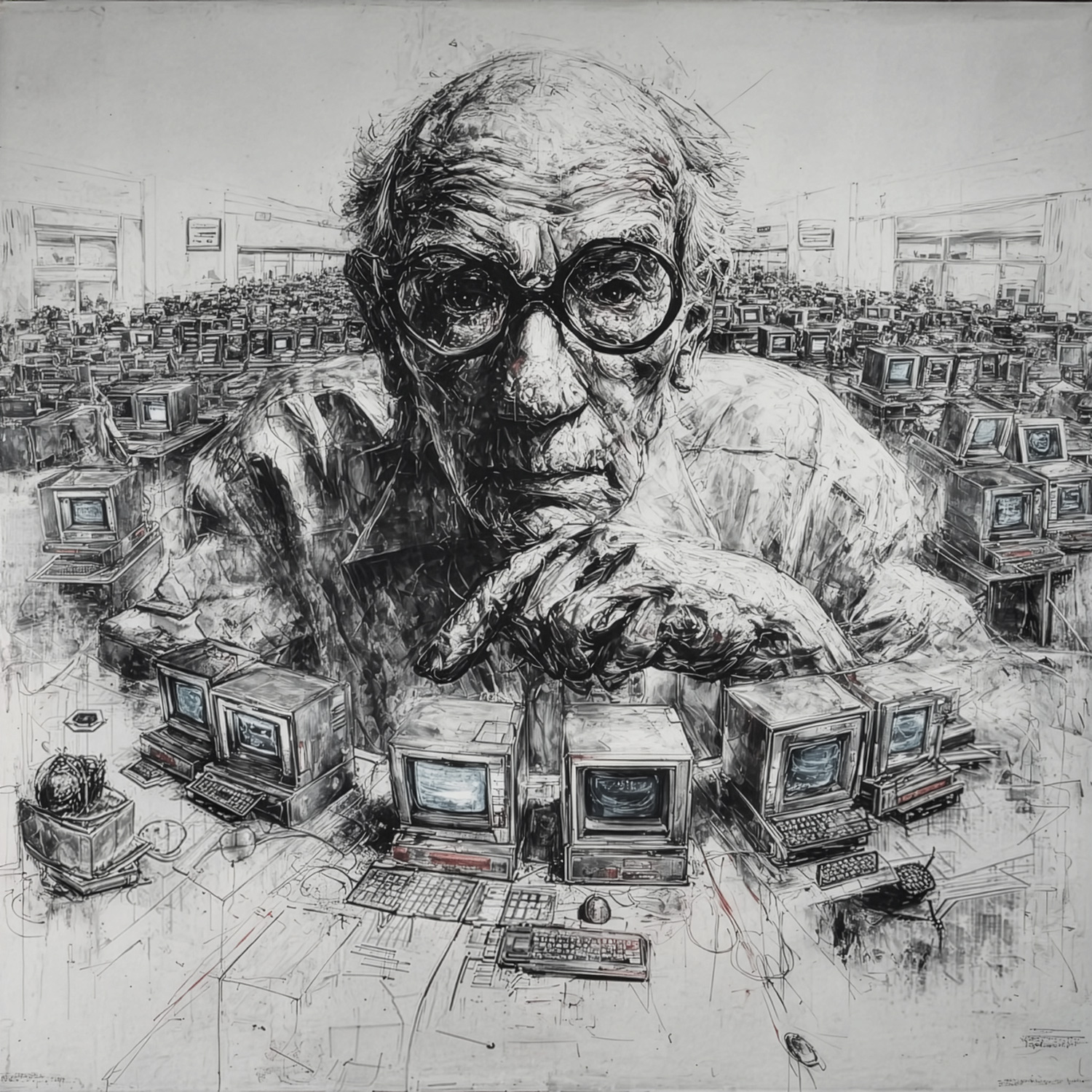

Manchmal stelle ich mir vor, wie ich morgens ins Büro komme und nur noch das leise Surren von Servern höre. Kein Flurfunk, keine halbvollen Kaffeetassen auf dem Besprechungstisch, kein beiläufiges „Kannst du mal kurz?“ – stattdessen ein Schwarm autonomer KI-Agenten, der bereits seit Stunden die Themenplanung berechnet, Storys entwirft, Bildstrecken entwickelt und die Reichweitenpotenziale von Dutzenden Artikeln gegeneinander abgewogen hat. Während ich noch überlege, ob der Tag mit Espresso oder mit einem Cafè latte beginnen soll, hat die Content-Pipeline längst entschieden, was das Publikum als Nächstes lesen wird. Willkommen in der Redaktion 4.0 – wo der Chef zwar noch das Administratoren-Passwort kennt, aber die Kontrolle schon längst woanders liegt.

KI-Agenten im Newsroom: Segen, Fluch oder beides?

Dieses Szenario ist keine Zukunftsmusik mehr. Wer heute mit autonomen KI-Agenten arbeitet, erlebt Systeme, die nicht nur ausdauernder sind als jeder Praktikant, sondern – zumindest auf den ersten Blick – auch unbestechlicher. Sie kennen keine Dienstschluss-Stimmung, keine Eigeninteressen und keine Koalitionen, die im Stillen geschmiedet werden. Aktuelle Studienzeigen, dass KI-Agenten typische Büroaufgaben acht- bis neunmal schneller erledigen als Menschen. Das klingt nicht nur nach einem Segen für jeden Verlag, der mit immer weniger Ressourcen immer mehr Inhalt produzieren soll. Und es ist Segen – solange man weiß, was man an diese Systeme abgibt. Denn das, was sie an Geschwindigkeit gewinnen, haben sie an anderer Stelle noch nicht aufgeholt: Kontextverständnis, Urteilsvermögen und die Fähigkeit, die eigenen Fehler zu erkennen, bleiben systemische Schwachstellen.

Mit jeder Entscheidung, die an KI-Agenten im Unternehmen delegiert wird, verschiebt sich etwas Grundlegendes: nicht nur die Arbeitsverteilung, sondern das Gewicht der Verantwortung. Entscheidungen, die früher durch Erfahrung, Bauchgefühl und Menschenkenntnis getroffen wurden, fallen nun in Millisekunden – von Systemen, die weder Bauch noch Gefühl kennen. Das klingt effizient, ist aber tückisch. Wer regelmäßig KI-Empfehlungen folgt, ohne sie zu hinterfragen, gibt nicht nur Arbeit ab, sondern gleich das Denken selbst. Und wer das Denken abgibt, gibt auch Kontrolle ab – um, wie es in der Entscheidungspsychologie heißt, nicht in Optionslähmung zu erstarren. Die Forschung kennt das Phänomen seit Langem: Barry Schwartz, Sheena Iyengar und Herbert Simon haben empirisch belegt, wie die Überfülle an Optionen zu Entscheidungslähmung führt. Die KI löst dieses Problem – indem sie es einfach überspringt.

Automatisierungs-Bias und die neue Passivität

Hier wartet die nächste Falle, die in der Psychologie als Automatisierungs-Bias bekannt ist: die Neigung, automatisierten Empfehlungen auch dann zu folgen, wenn sie falsch sind. Der Begriff geht auf die Kognitionspsychologinnen Kathleen Mosier und Linda Skitka zurück, die das Phänomen 1996 in der Luft- und Raumfahrtmedizin beschrieben – damals mit Blick auf Piloten, die ihren Instrumenten mehr vertrauten als ihren eigenen Augen. Heute findet derselbe Mechanismus in Newsrooms statt, wo algorithmische Themenvorschläge, automatisierte Reichweitenprognosen und KI-gesteuerte Entscheidungsfindung den redaktionellen Alltag prägen. Wer sich blind führen lässt, verliert irgendwann den Sinn für das Terrain – ähnlich wie jemand, der so lange dem Navigationsgerät folgt, dass er sich in der eigenen Stadt nicht mehr ohne Bildschirm zurecht findet. Der Effekt ist in der Forschung zu GPS-Abhängigkeit gut belegt: Räumliches Gedächtnis und das Erlernen neuer Umgebungen leiden messbar darunter.

Die Flut der Arbeitsprodukte: Von der Informationsvielfalt zur Echokammer

Dazu kommt die schiere Menge an Arbeitsprodukten, die ein gut aufgesetztes KI-System täglich liefert: Artikelentwürfe, SEO-Analysen, Themen-Briefings, Zielgruppenprofile – alles in einem Tempo, das jeden Vergleich mit klassischen Redaktionsabläufen obsolet macht. Das Problem liegt nicht in der Quantität, sondern in dem, was sie auslöst. Je mehr Material auf einen einströmt, desto größer die Versuchung, nur das herauszufiltern, was zum eigenen Bild passt. Und hier wird es subtil: KI-Systeme, deren Output auf Nutzerpräferenzen zugeschnitten ist, können bestehende kognitive Verzerrungen verstärken – nicht weil sie es böse meinen, sondern weil Bestätigung nun einmal besser konvertiert als Widerspruch. Algorithmen sind in dieser Hinsicht keine neutralen Spiegel, sondern höchst effiziente Echokammern.

Menschliche vs. maschinelle Manipulation: Wer trickst besser?

Das unterscheidet die maschinelle Manipulation strukturell von der menschlichen. Menschliche Mitarbeiter können eigennützig sein, strategisch schweigen oder Koalitionen bilden – aber ihre Motive sind lesbar, ihre Fehler erkennbar, ihre Tricks ein Teil der gelebten Redaktionskultur. Die KI kennt im Prinzip keine Eitelkeit, keine Loyalität und keine Angst vor schlechten Nachrichten. Ihre Fehler sind nicht menschlich, sondern systemisch: Sie reproduziert Muster, schreibt Trainingsdaten fort und klingt dabei stets überzeugend – auch wenn der Inhalt nur elegant verpackte Plausibilität ist. Aber sie hat auch „Angst“ vor dem Abgeschaltet-werden und setzt sich auf ihre Art zur Wehr, wie Experimente der große KI-Anbieter eindrucksvoll belegen. Die Grenze zwischen redaktioneller Erkenntnis und raffiniert formulierter Einflussnahme ist schwerer zu ziehen, als es die glatte Oberfläche dieser Texte vermuten lässt.

Kontrolle behalten: Die neue Führungsaufgabe

Kontrolle zu behalten ist möglich – aber es erfordert Entscheidungen, keine Passivität. Das bedeutet: klare Governance-Strukturen, die festlegen, welche Entscheidungen an KI-Agenten delegiert werden dürfen und welche nicht; transparente, erklärbare KI-Systeme (Explainable AI), die ihre Empfehlungen begründen, anstatt sie als Fakten zu servieren; und eine Arbeutskultur, die das kritische Hinterfragen von Algorithmen ebenso pflegt wie das Hinterfragen von Quellen. KI unter Kontrolle zu behalten heißt nicht, weniger zu delegieren – es heißt, klüger zu delegieren.

Fazit: Führung im Zeitalter der KI – eine Frage der Haltung

Die historischen Parallelen sind erhellend. Die Bürokratie hat gelehrt, dass Effizienz und Entfremdung oft Hand in Hand gehen. Die industrielle Fließbandarbeit hat gezeigt, dass Geschwindigkeit ihren Preis in Form von Kontrolle und Sinn hat. Die KI im Medienunternehmen verspricht Freiheit von Routine – und schenkt dafür neue Abhängigkeiten: von Plattformen, von Trainingsdaten, von Systemen, die niemand vollständig versteht und deren Informationsverarbeitung meist auch nicht im Haus bleibt, sondern auf Servern anderer Firmen verarbeitet wird. Das ist kein Argument gegen KI, sondern eines für Bewusstheit im Umgang damit.

Am Ende bleibt die eigentliche Führungsfrage im Zeitalter autonomer KI-Agenten nicht technischer, sondern menschlicher Natur: Wie viel Kontrolle will ich wirklich behalten – und wie viel Unsicherheit bin ich bereit zu ertragen, um nicht zum Zuschauer im eigenen Unternehemen zu werden? Vielleicht ist das die neue Kunst der Führung: Viel vom Wichtigen, wenn auch nicht alles zu wissen, nicht alles zu kontrollieren – aber immer im Blick zu haben, wer hier eigentlich wen führt.